自变量推出新一代机器人进家庭计划

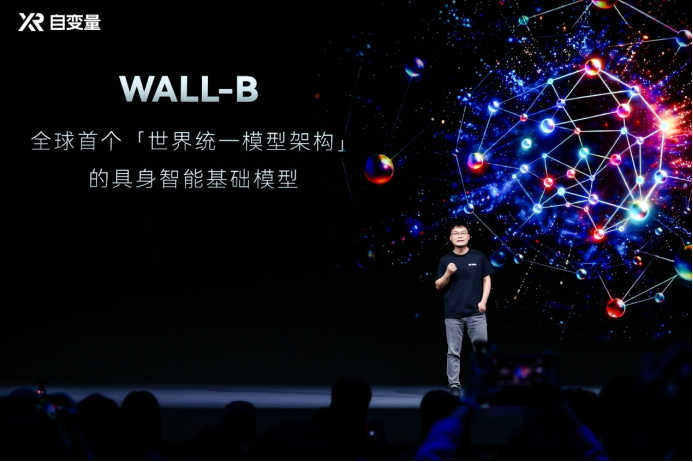

中国网/中国发展门户网讯(记者徐林) 4月21日,自变量机器人举办新品发布会,正式推出新一代机器人进家庭计划。该机器人将搭载新一代自研具身智能基础模型WALL-B,这是全球首个基于世界统一模型(WUM)架构的具身智能基础模型。

发布会上,自变量创始人兼CEO王潜、联合创始人兼CTO王昊全面解读了WALL-B模型的技术架构、数据策略和训练机制,并正式宣布,首批搭载该模型的新一代机器人将于下月入驻真实家庭,开启机器人服务家庭生活的成长之旅。

自变量创始人兼CEO王潜发言。

“早上七点,闹钟响了。你从床上爬起来,走到客厅。拖鞋不知踢到哪里,厨房的碗还没洗,孩子的书包扔在地上,猫打翻了一杯水。”王潜以一段极具画面感的日常场景开场,直观揭示了家庭环境的核心特质——随机、碎片且不断变化。他表示,目前全球范围内,尚无任何一台机器人能在无遥控操作的情况下,独立完成上述场景中的综合整理任务。

王潜指出,当前机器人普及的核心瓶颈不在本体硬件,而在智能系统。家庭环境中的每一秒都可能出现全新事件:猫何时跳上桌子、孩子将玩具扔到何处、地毯的摩擦力与实验室地板存在差异等。现有技术无法有效处理这种随机性和碎片化,“机器人进入家庭是我们这个时代最难的技术问题之一。”

自变量联合创始人兼CTO王昊发言。

自变量联合创始人兼CTO王昊表示,自变量机器人始终聚焦于为机器人构建“大脑”,即端到端的具身智能基础模型。2024年底,公司发布基于VLA(视觉-语言-动作)架构的第一代具身基础模型WALL-A;去年9月,公司将同样思路架构下的轻量化模型版本WALL-OSS开源;此外,自变量还与58同城合作,将搭载WALL-AS模型的机器人送入真实家庭,与保洁阿姨协同作业,实现全球首次机器人进入家庭服务,首次在C端复杂环境大规模落地的突破。

正是真实家庭的部署,让团队看到了VLA架构的“天花板”。王昊解释道,VLA架构本质上是视觉、语言、动作三个独立模块的拼接,数据在这三个模块之间逐级传递,每经过一次模块边界就会发生信息损耗和延迟。更核心的问题在于,VLA模型只能模仿训练数据中的动作轨迹,无法真正理解物理世界的规律。“它不理解杯子为什么会掉,不理解为什么盘子悬在桌边需要推回去。它只是在重复见过的动作。”王昊强调,“WALL-B的推出,正是对这一困局的突破性回应。它并非WALL-A的迭代升级,而是从底层架构到训练范式的全面重构。”他介绍,其与行业其他方案的核心区别,在于实现了从VLA到WUM(世界统一模型)的跨越。WUM的核心理念是,将视觉、语言、动作、物理预测等所有能力,整合到同一个网络中从零开始联合训练、深度融合,彻底消除模块间的边界和数据搬运损耗。基于此,WALL-B实现了三项区别于行业现有模型的核心技术特征:

第一,原生多模态。WALL-B实现“多模态进、多模态出”,无需通过“传话”方式在不同模块间转译信息。“它看到杯子的同时就已经在准备伸手,感觉到重量的同时就已经在调整力度。”王昊举例说明。同时,模型还具备“原生本体感”,能够内生感知自身空间尺寸(如高度、宽度、手臂伸展范围),并自主判断能否通过某个空间、触及某个物体,无需依赖外部测量或建模。

第二,物理世界的“世界观”。WALL-B能够感知并预测重力、惯性、摩擦力、速度等基本物理规律。在从未见过的场景中也能做出合理判断。例如,当盘子一半悬空在桌沿外时,模型可以推断出盘子可能掉落摔碎,从而采取预防动作。它同时也具备零样本泛化能力,在任何一个它从未接触过的家庭环境中,也能凭借对物理常识的理解,灵活应对新场景、新问题。

第三,与世界交互并自我进化。这是WUM架构区别于所有现有VLA模型的最根本特征。WALL-B在执行任务失败后,会自主调整策略再次尝试,若成功,则会将此次成功的经验直接更新到模型参数中,实现自我迭代。整个过程无需工程师重新训练、人工注入新数据,也无需返回实验室调试,就像人类学习使用筷子——即便多次掉落,也能通过调整手部力度和角度,最终掌握技能。

5月25日,部署WALL-B的新一代机器人将入驻首批用户的家庭。

发布会上,王潜公布了新一代机器人的落地时间:5月25日,搭载WALL-B模型、并针对家居环境完成硬件升级的新一代机器人,将正式入驻首批用户家庭。目前,自变量已启动招募首批家庭机器人的家长,用户可通过官方渠道提交申请。

针对用户最关心的隐私保护问题,王潜表示,机器人在设备端对原始图像进行实时打码处理,确保其“看到”的是已去除个人特征的场景数据;设备开机需用户主动按下同意键,不存在“默认同意”的情况;用户信息不共享给第三方,机器人只识别唯一主人,一旦检测到可疑指令,立即锁定设备。

同时,王潜也表示,当前WALL-B模型仍处于“实习生”阶段,难免会出现失误,需要远程协助,它有时可能把拖鞋放到厨房,或者擦桌子擦到一半停下来“思考”。但该模型具备24小时不间断工作的优势,且每工作一天,都会通过收集新场景数据而变得更“聪明”。

搭载WALL-B模型的机器人正在现场演示插花操作。中国网徐林/摄

在发布会场外的展示区,摆放着一束束鲜花,两台搭载WALL-B模型的机器人正在现场演示插花操作:它们的“双手”协同配合,将三枝花依次精准插入同一个花瓶中。现场工作人员介绍:“插花是一项复杂度极高的任务,既要求模型具备精准的空间感知能力、灵活的抓取控制能力,还需要双手实现完美协同,这充分体现了我们的模型对不同环境变化、不同物体形态,都具备极强的实时推理和泛化能力。”